매일, AI 기사를 만나보세요

보다보면 나만의 아이디어가 떠오를지도?

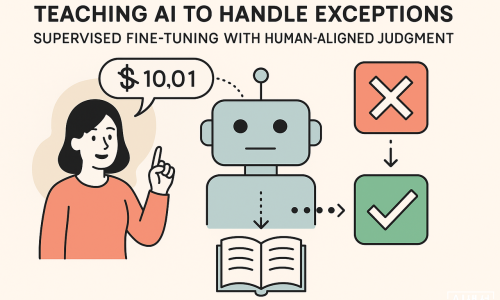

"AI 에이전트는 융통성이 필요해"...MIT, LLM '예외적 사고' 강화법 공개

생성형 AI가 “규칙대로만” 고집해 현실에서 납득 못할 결정을 내리는 한계가 드러났다.

MIT 슬론 연구진은 인간처럼 예외를 판단하려면 ① 윤리 프롬프트만으론 부족하고 ② 생각 과정을 풀어쓰는 CoT도 한계가 있으며 ③ 사람의 ‘판단 이유’를 담은 50개 안팎의 설명 데이터로 지도‧미세조정(SFT) 해야 효과가 크다고 발표했다.

실험 후 GPT-4o 미니는 ‘예산보다 1센트 비싼 밀가루’도 사야 한다는 답을 70% 넘게 선택, 인간(92%)에 가깝게 변했다.

AI 에이전트가 산업·의료 현장서 신뢰받으려면 “무엇을”뿐 아니라 “왜 그렇게 결정했는지” 학습시키는 설계가 필수라는 메시지다.

@@AI 에이전트 융통성, 어떻게 길러야 할까?@@

1. LLM이 ‘예외’를 무시해 생기는 실제 사례는 무엇일까?

→ 뉴스·논문에서 단일 규칙 때문에 오류가 난 사례를 3건 찾아 정리해 보세요.

2. 윤리 프롬프트·CoT·SFT 세 방법의 차이를 이해했나요?

→ 각각의 원리를 3줄로 요약하고, 장단점을 표로 비교해 보세요.

3. 고교 수준에서 ‘사람처럼 판단 이유를 설명한 데이터’ 50개를 모을 수 있을까?

→ 친구·가족에게 질문을 던져 답변·이유를 함께 기록하여 작은 SFT 세트를 만들어 보세요.

4. 작은 SFT 세트를 직접 시험해 보려면?

→ 무료 LLM(오픈소스) 모델에 LoRA 미세조정을 적용하고, 전‧후 응답을 비교해 보세요.

#인공지능 #인공지능윤리 #인공지능뉴스 #인공지능기사 #AI #AI기사 #인공지능세특 #세특 #입시 #AI세특 #GPT #GPT4 #ChatGPT #인공지능용어 #인공지능지식 #인공지능상식 #AI상식 #AI용어 #AI지식 #AI기술 #AI에이전트 #예외처리 #융통성강화 #SFT학습 #고교AI실험